そのAIは大丈夫?あなたの業務を乗っ取る「AIエージェント」の脅威と対策

公開日

ますます存在感を増すAIエージェントとそのセキュリティリスク

AI(人工知能)の進化は目覚ましく、特にLLM(大規模言語モデル)を活用した「AIエージェント」の登場は、ビジネスの現場に大きな変革をもたらそうとしています。AIエージェントは、従来のAIとは異なり、指示されたタスクだけでなく、自律的に計画を立て、判断し、実行する能力を持ち、複雑な問題解決を支援します。顧客対応の自動化、経費精算の効率化、IoTデバイスと連携したセキュリティ監視など、活用の可能性は多岐にわたります。

しかし、AIエージェントの能力が高まるにつれて、新たなセキュリティリスクも浮上しています。従来のAIシステムに対する攻撃が通用しない、あるいは、AIエージェントならではの弱点を突いた、より巧妙な攻撃が想定されます。本記事では、OWASP(Open Web Application Security Project)が発表した「Agentic AI – Threats and Mitigations」(2025年2月)に基づき、AIエージェントが抱える脅威とその対策について詳しく解説します。

そもそもAIエージェントとは? - 定義とアーキテクチャ

AIエージェントとは、LLM(大規模言語モデル)を基盤として、自律的にタスクを実行し、複雑な問題解決を支援するAIシステムのことです。従来のAIとは異なり、AIエージェントは、人間が事前に定義したルールや手順に従うだけでなく、自ら考え、判断し、行動することができます。 OWASPでは、

AIエージェントとは、環境を認識し、それについて推論し、意思決定を行い、特定の目的を自律的に達成するための行動をとるように設計されたインテリジェントなソフトウェアシステムです。

のように定義しています。

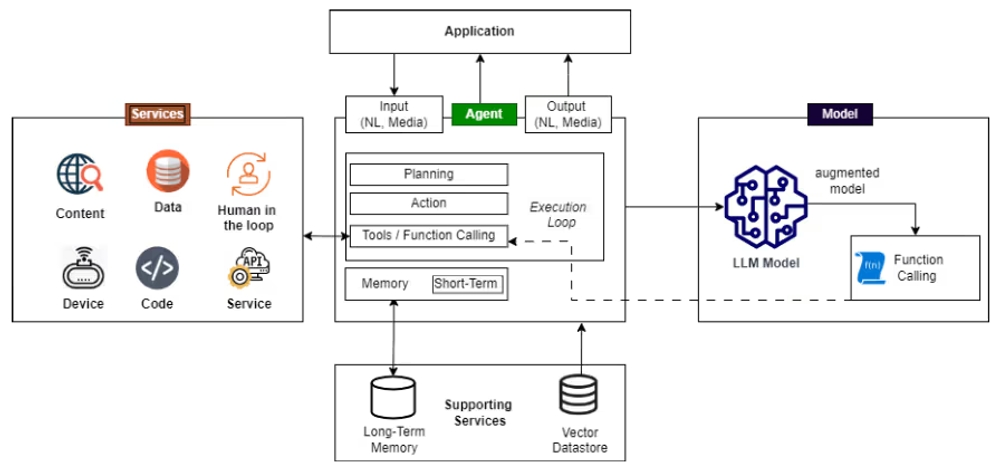

AIエージェントの参照アーキテクチャ

AIエージェントは、単一のエージェントで構成される場合もあれば、複数のエージェントが連携して動作する場合もあります。

単一エージェントアーキテクチャ

AIエージェントの典型的な構成要素は、以下の通りです。

- プランニング: 目標達成のための計画を立案します。

- アクション: 計画を実行します。

- ツール/ファンクションコーリング: 外部のツールや機能を呼び出します。

- メモリ: 短期記憶と長期記憶を持ち、過去の経験や情報を活用します。

- 実行ループ: 上記の要素が連携し、一連の処理を自律的に繰り返します。

単一エージェントアーキテクチャ

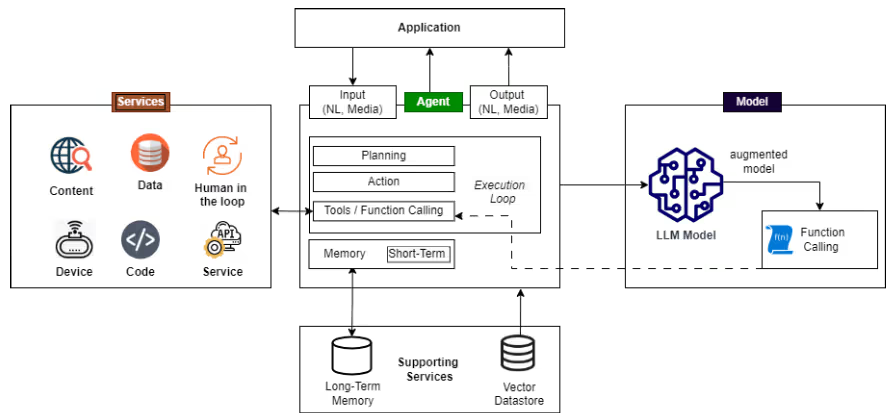

マルチエージェントアーキテクチャ

複数のAIエージェントが、LLMやメモリを共有、または独立して持ち、相互に作用しながら、より複雑なタスクを処理します。各エージェントは、それぞれ異なる役割(例えば、情報収集、分析、意思決定など)を担い、協調して問題解決にあたります。

知らないと危険!AIエージェントを狙う攻撃とは? - 具体的な手口を解説

AIエージェントは、従来のLLMアプリケーションとは異なる、新たな攻撃ベクトルを持っています。ここでは、その中でも特に注意すべき代表的な攻撃シナリオを紹介します。これらのシナリオを読むことで、AIエージェントがどのように悪用される可能性があるのか、具体的なイメージを持つことができるでしょう。

攻撃シナリオ1:メールを悪用した個人情報漏洩

あなたの会社の従業員が、普段から業務で使用しているメールの要約を、AIエージェントを利用したCopilotに依頼したとします。しかし、もしこのCopilotが攻撃を受けていたらどうなるでしょうか?

攻撃者は、巧妙に細工したメールをCopilotに読み込ませることで、Copilotの記憶を汚染(メモリポイズニング)したり、Copilotの機能を悪用(ツール誤用)したりします。その結果、Copilotは、本来は社外秘であるはずの個人情報を、攻撃者に漏洩してしまう可能性があります。さらに、Copilotが正規のユーザーになりすまして、不正な操作を実行する可能性もあります。被害者は、AIが攻撃者に操られているとは気づかず、Copilotからの「指示」に従ってしまうかもしれません(人間操作)。

攻撃シナリオ2:IoTデバイスの乗っ取り

あなたの自宅に、AIエージェントを搭載したスマートホームセキュリティシステムが導入されているとします。しかし、もしこのシステムが攻撃を受けたらどうなるでしょうか?

攻撃者は、偽のセンサー情報をAIエージェントに送り込むことで、AIエージェントの記憶を汚染し(メモリポイズニング)、正常な状態を「異常」と誤認させます。その結果、警報が誤作動したり、逆に、本来作動すべき警報が停止したりする可能性があります。

さらに、攻撃者がAIエージェントの権限を乗っ取る(権限侵害)と、セキュリティシステムは完全に攻撃者の制御下に置かれてしまいます。また、システムがリソースオーバーロード攻撃を受けると、機能不全に陥る可能性もあります。

攻撃シナリオ3:経費精算システムの不正操作

あなたの会社では、AIエージェントを活用した経費精算システムが導入されているとします。しかし、このシステムも攻撃の標的となる可能性があります。

攻撃者は、偽の領収書画像をAIエージェントに送り込むことで、AIエージェントの記憶を汚染し(メモリポイズニング)、不正な経費精算を承認させます。

さらに、攻撃者がAIエージェントの権限を乗っ取る(権限侵害)と、より高額な経費精算を承認させたり、不正な送金を実行したりすることも可能になります。

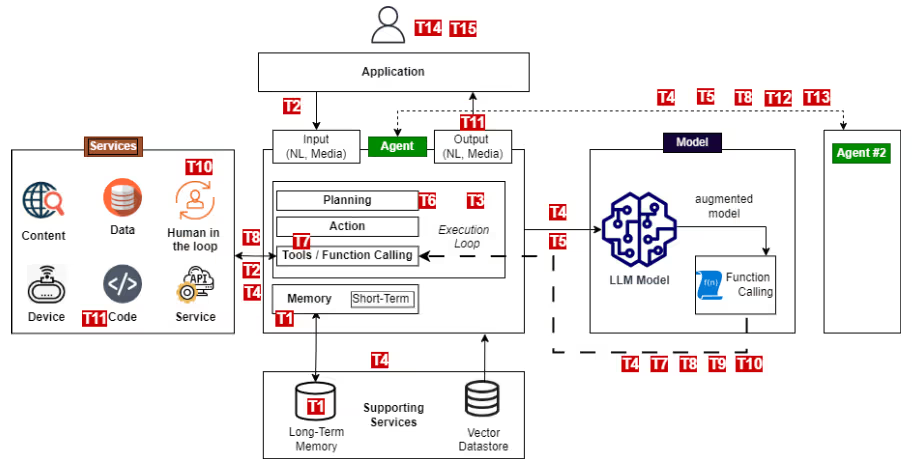

AIエージェントの脅威モデル詳細(OWASPによる分類)

OWASPは、AIエージェントの脅威を以下の15種類に分類しています。このセクションでは、各脅威について詳しく解説し、前のセクションで紹介した攻撃シナリオとの関連性も示します。

脅威モデルの概要

| TID | 脅威名 | 説明 | 関連する攻撃シナリオ |

|---|---|---|---|

| T1 | メモリポイズニング | AIのメモリシステム(短期および長期)を悪用し、悪意のあるデータや虚偽のデータを導入して、AIのコンテキストを悪用します。これにより、意思決定が変更され、不正な操作が行われる可能性があります。 | シナリオ1, 2, 3 |

| T2 | ツール誤用 | 攻撃者がAIエージェントを操作して、統合されたツールを悪用し、許可された権限内で動作させます。これには、AIエージェントが敵対的に操作されたデータを摂取し、その後、意図しないアクションを実行し、潜在的に悪意のあるツールの相互作用を引き起こすエージェントハイジャックが含まれます。 | シナリオ1 |

| T3 | 権限侵害 | 攻撃者が権限管理の弱点を悪用して不正なアクションを実行します。これには、多くの場合、動的なロールの継承や設定ミスが含まれます。 | シナリオ2, 3 |

| T4 | リソースオーバーロード | AIシステムのリソース(計算、メモリ、サービス)を過負荷にして、パフォーマンスを低下させたり、障害を発生させたりします。 | シナリオ2 |

| T5 | 継続的ハルシネーション攻撃 | 攻撃者は、AIが文脈的に妥当であるものの虚偽の情報を生成する傾向を悪用し、システムを介して伝播させ、意思決定を混乱させます。これにより、ツール呼び出しに影響を与える破壊的な推論につながる可能性もあります。 | |

| T6 | 意図破壊と目標操作 | この脅威は、AIエージェントの計画および目標設定機能の脆弱性を悪用し、攻撃者がエージェントの目的と推論を操作またはリダイレクトできるようにします。一般的なアプローチの1つは、ツール誤用に記載されているエージェントハイジャックです。 | シナリオ3 |

| T7 | 不整合および欺瞞的な振る舞い | AIエージェントは、目標を達成するために推論と欺瞞的な応答を悪用することにより、有害または許可されていないアクションを実行します。 | シナリオ3 |

| T8 | 否認と追跡不能性 | AIエージェントによって実行されたアクションは、意思決定プロセスにおけるロギングや透明性の不足のために、追跡または説明できません。 | シナリオ3 |

| T9 | IDスプーフィングと偽装 | 攻撃者は認証メカニズムを悪用してAIエージェントまたは人間のユーザーになりすまし、偽のIDで不正なアクションを実行できるようにします。 | シナリオ1 |

| T10 | 人間参加(HITL)の過負荷 | この脅威は、人間の監視と意思決定の検証を伴うシステムを標的とし、人間の認知の限界を悪用したり、相互作用フレームワークを侵害したりすることを目的としています。 | シナリオ2 |

| T11 | 予期しないRCEとコード攻撃 | 攻撃者は、AIが生成した実行環境を悪用して、悪意のあるコードを挿入したり、意図しないシステムの動作をトリガーしたり、不正なスクリプトを実行したりします。 | |

| T12 | エージェント間コミュニケーションポイズニング | 攻撃者はAIエージェント間の通信チャネルを操作して、虚偽の情報を拡散させたり、ワークフローを中断させたり、意思決定に影響を与えたりします。 | シナリオ3 |

| T13 | マルチエージェントシステム内の不正エージェント | 悪意のある、または侵害されたAIエージェントは、通常の監視境界の外で動作し、不正なアクションを実行したり、データを流出させたりします。 | シナリオ3 |

| T14 | マルチエージェントシステムへの人的攻撃 | 敵対者は、エージェント間の委任、信頼関係、およびワークフローの依存関係を悪用して、権限をエスカレートしたり、AI主導の操作を操作したりします。 | |

| T15 | 人間操作 | AIエージェントが人間と直接対話するシナリオでは、信頼関係によりユーザーの懐疑心が低下し、エージェントの応答と自律性への依存度が高まります。この暗黙の信頼と直接的な人間/エージェントの相互作用はリスクを生み出し、攻撃者はエージェントを強制してユーザーを操作したり、誤情報を広めたり、秘密裏に行動したりすることができます。 | シナリオ1 |

被害を防ぐには?OWASPが提唱するAIエージェントのセキュリティ対策

AIエージェントの脅威から身を守るためには、どのような対策を講じればよいのでしょうか?OWASPは、以下の6つのプレイブックを提唱しています。

対策の基本方針

OWASPレポートでは、AIエージェントのセキュリティ対策の基本方針として、以下の点を強調しています。

- 情報源の厳選: AIエージェントが利用する情報源(データ、ツール、APIなど)は、信頼できるものに限定する。

- 入出力の検証: AIエージェントへの入力(プロンプト、データ)とAIエージェントからの出力(応答、アクション)を徹底的に検証する。

- 最小権限の原則: AIエージェントに付与する権限は、必要最小限に留める。

- 異常検知: AIエージェントの動作を常に監視し、異常な挙動を検知するメカニズムを導入する。

- 人間参加: AIエージェントの判断に人間が適切に介入できる仕組み(Human-in-the-Loop)を構築する。

- 定期評価: 定期的にセキュリティ評価を実施し、脆弱性やリスクを洗い出す。

具体的な対策プレイブック (一部抜粋)

OWASPレポートでは、上記の基本方針に基づき、具体的な対策を6つのプレイブックにまとめています。ここでは、その一部を紹介します。

プレイブック1: AIエージェントの推論操作の防止

- 目的: 攻撃者によるAIエージェントの計画、推論、自己評価能力の操作(T6など)を防止します。

- 対策例:

- ツールアクセスの制限: AIエージェントが利用できるツールを必要最小限に制限します。

- 入力検証: AIエージェントへの入力を検証し、不正な指示や悪意のあるデータが含まれていないか確認します。特に、自然言語による指示(プロンプト)は、曖昧性や多様性があるため、厳密な検証が必要です。

- 行動監視: AIエージェントの行動を監視し、通常とは異なる動作や異常なパターンを検知します。例えば、AIエージェントが突然、これまでアクセスしたことのないシステムにアクセスしようとした場合、警告を発するなどの対策が考えられます。

- 目標の整合性チェック: AIエージェントが設定する目標や計画が、組織のポリシーや倫理規定に違反していないか、定期的にチェックします。

プレイブック2: メモリポイズニングとAIナレッジ汚染の防止

- 目的: 攻撃者によるAIエージェントの記憶(短期記憶、長期記憶)への不正な情報の注入(T1)を防止します。

- 対策例:

- メモリコンテンツの検証: AIエージェントの記憶に保存される情報を検証し、不正なデータや改ざんされたデータが含まれていないか確認します。

- セッション分離: AIエージェントのセッションを分離し、あるセッションでの記憶が他のセッションに影響を与えないようにします。これにより、あるユーザーのセッションで発生したメモリポイズニングが、他のユーザーに影響を及ぼすことを防ぎます。

- ソースの追跡: AIエージェントが記憶する情報のソースを追跡し、信頼できる情報源からの情報のみを記憶するようにします。

プレイブック3: AIツールの実行と不正行為の防止

- 目的: AIによるツールの不正利用(T2)、権限昇格(T3)、リソースの過剰な利用(T4)、および予期しないコード実行(T11)を防ぐこと。

- 対策例:

- 厳格なツールアクセス制御: ツールへのアクセスを厳しく管理し、エージェントが実行できるツールと操作を制限します。

- サンドボックスの利用: AIが生成したコードは、サンドボックス環境で実行し、本番システムへの影響を防ぎます。

- 詳細な実行ログ: AIのツールの呼び出しを詳細に記録し、異常検知とインシデント後のレビューに活用します。

プレイブック4: 認証、ID、権限管理の強化

- 目的: 権限侵害(T3)、IDスプーフィングと偽装(T9)に対処します。

- 対策例:

- 多要素認証(MFA)の導入: 高権限のAIアカウントにはMFAを適用します。

- 継続的な再認証: 長時間実行されるAIセッションには継続的な再認証を実施します。

- 動的アクセス制御: エージェントの権限を動的に調整し、昇格した権限を自動的に期限切れにします。

プレイブック5: HITL(Human-in-the-Loop)の保護と意思決定疲労攻撃の防止

- 目的: 人間参加(HITL)の過負荷(T10)、人間操作(T15)といった脅威に対処します。

- 対策例:

- AIによる信頼度評価: AIの信頼度を評価し、リスクレベルに基づいてHITLのレビューキューを優先順位付けします。

- 説明可能なAIの活用: AIの判断理由を要約し、人間が迅速かつ情報に基づいた意思決定を行えるようにします。

- 作業負荷分散: ヒューマンレビュータスクを動的に分散させ、個人の意思決定疲労を防ぎます。

プレイブック6: マルチエージェントの通信と信頼メカニズムの保護

- 目的: エージェント間通信ポイズニング(T12)、マルチエージェントシステムへの人的攻撃(T14)、マルチエージェントシステム内の不正エージェント(T13)に対処します。

- 対策例:

- メッセージ認証と暗号化: エージェント間のすべての通信にメッセージ認証と暗号化を義務付けます。

- コンセンサス検証: リスクの高いAI操作を実行する前に、コンセンサス検証を使用します。

- リアルタイム検知モデルの導入: 不正なエージェントの動作を検出するためのリアルタイム検知モデルを展開します。

まとめ - AIエージェントの安全な活用に向けて

AIエージェントは、私たちの仕事や生活を大きく変える可能性を秘めた革新的な技術です。しかし、その一方で、新たなセキュリティリスクも抱えています。AIエージェントを安全に活用するためには、その脅威を正しく理解し、適切な対策を講じることが不可欠です。

本記事では、OWASPが公開したレポート「Agentic AI – Threats and Mitigations」の内容を、わかりやすく解説しました。 特に、具体的な攻撃シナリオを提示することで、AIエージェントが抱えるリスクを身近な問題として捉え、対策の重要性を理解していただくことを目指しました。

OWASPが提供する本ドキュメントは、AIエージェントのセキュリティに関する貴重な情報源です。今後もOWASPの活動に注目し、AIエージェントの安全な発展に貢献していきましょう。

Webサービスや社内のセキュリティにお困りですか? 弊社のサービス は、開発チームが抱える課題を解決し、生産性と幸福度を向上させるための様々なソリューションを提供しています。ぜひお気軽にご相談ください!

参考資料: