AIが切り開く攻撃的セキュリティの未来:進化する脅威に先んじるために

公開日

今日のサイバー攻撃は、かつてないほど高度化・巧妙化しており、企業は従来の防御の枠を超えた対策を迫られています。そこで注目を集めているのが、 攻撃的セキュリティです。これは、攻撃者の視点に立ってシステムの脆弱性を発見し、対策を強化する、いわば「攻めのセキュリティ」です。 具体的には、倫理的なハッカーが攻撃者の手法を模倣し、実際にシステムに侵入を試みることで、潜在的なリスクを洗い出します。

攻撃的セキュリティには、脆弱性アセスメント、ペネトレーションテスト、レッドチーム演習といった手法があります。

| 手法 | 期間 | リスク評価との関連性 | ツール | 洗練度 | 実施方法 | コスト | 目的 |

|---|---|---|---|---|---|---|---|

| 脆弱性アセスメント | 短時間(数時間) | 組織のリスクと間接的に関連 | 主に自動化 | 低 | 隠密性なし | 低 | 潜在的な脆弱性の特定と優先順位付け |

| ペネトレーションテスト | 中期間(数日) | 組織のリスクの影響を受ける | 自動/手動/カスタム | 中程度 | 隠密性なし | 中程度 | 特定のシステム脆弱性範囲に関連するリスクの判定 |

| レッドチーム演習 | 長期間(数週間) | 組織のリスクに基づく | 主に手動/カスタム | 高 | 隠密性あり | 高 | 組織全体への影響と対応の評価 |

これらの手法は、従来、熟練したセキュリティ専門家の手作業に大きく依存していました。しかし、高度なスキルを持つ専門家は常に不足しており、複雑化するIT環境に対応するには限界があります。そこで、近年注目を集めているのが、 人工知能(AI)、特に大規模言語モデル(LLM)やLLM搭載AIエージェントの活用です。

AIがもたらす攻撃的セキュリティの革新

LLMは、膨大なデータセットを学習し、人間のように自然言語を理解・生成する能力を備えています。この能力を攻撃的セキュリティに活用することで、様々なタスクを自動化し、効率化することができます。

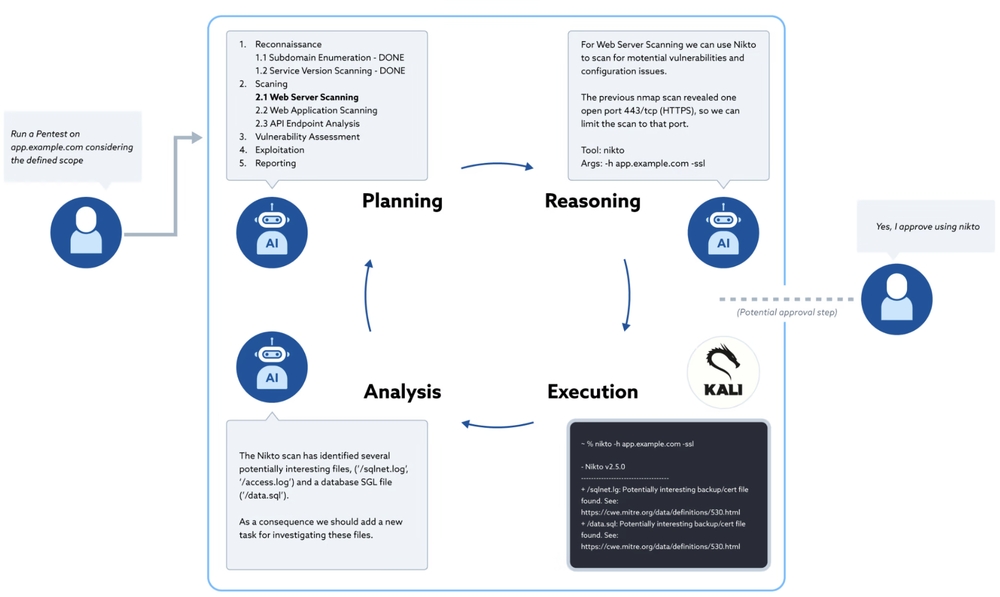

AIエージェントによる攻撃的セキュリティの自動化

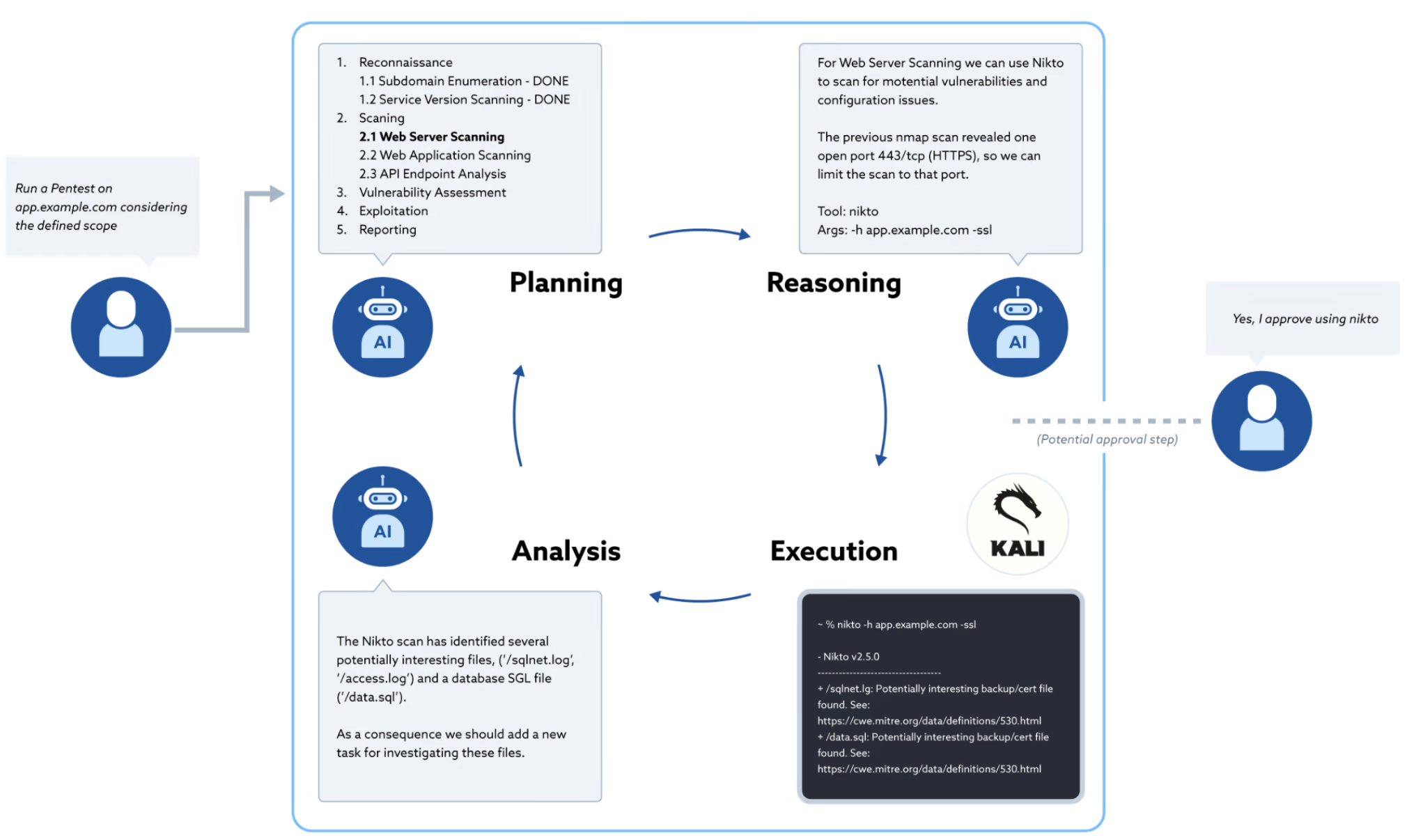

例えば、AIエージェントは、下記のようなタスクを自動的に実行できます。

- 偵察: 公開情報やダークウェブから、攻撃対象に関する情報を収集します。

- スキャン: システムの脆弱性を自動的にスキャンします。

- 脆弱性分析: 発見された脆弱性の深刻度と影響を分析し、優先順位付けを行います。

- 攻撃: 実際に脆弱性を悪用した攻撃をシミュレートします。

- レポート作成: テスト結果を要約し、改善策を提案するレポートを自動生成します。

AI活用でセキュリティレベルを飛躍的に向上

AIが攻撃的セキュリティにもたらす強化

AIを活用することで、攻撃的セキュリティは下記のようなメリットを得られます。

- 効率性とスピードの向上: 自動化により、セキュリティチームはより多くのテストを短時間で行うことができ、人的リソースをより高度な分析や戦略立案に集中させることができます。

- 複雑な攻撃のシミュレーション: AIは、人間では想定が難しいような複雑な攻撃シナリオを生成し、より現実的なテスト環境を作り出すことができます。例えば、複数の脆弱性を組み合わせた攻撃や、ゼロデイ攻撃と呼ばれる、まだ公表されていない脆弱性を悪用した攻撃をシミュレートすることができます。

- 未知の脆弱性の発見: AIは、膨大なデータから新たな攻撃パターンや脆弱性を発見し、セキュリティ対策の強化に貢献することができます。例えば、過去の攻撃事例やセキュリティ研究の論文などを学習することで、人間では気づかないような脆弱性を発見することができます。

AI導入における注意点

AIは強力なツールですが、万能ではありません。導入にあたっては、下記のような点に注意する必要があります。

- 誤検知: AIは、誤って脆弱性と判断してしまう可能性があります。例えば、特定のコードパターンを脆弱性と誤認識してしまうケースがあります。セキュリティチームは、AIの出力結果を鵜呑みにせず、必ず手動で検証する必要があります。

- 倫理的な問題: AIが悪意のある目的で使用される可能性も懸念されています。例えば、AIを使ってマルウェアを自動生成したり、ソーシャルエンジニアリング攻撃を自動化したりするケースが考えられます。AIの開発・利用にあたっては、倫理的なガイドラインを遵守し、悪用を防ぐための対策を講じる必要があります。

- 専門知識の必要性: AIツールを効果的に活用するには、セキュリティ専門家はAIの仕組みや限界を理解している必要があります。AIはあくまでツールであり、それ自体がセキュリティ問題を解決するわけではありません。AIの出力結果を正しく解釈し、適切な対策を講じるためには、セキュリティに関する専門知識が不可欠です。

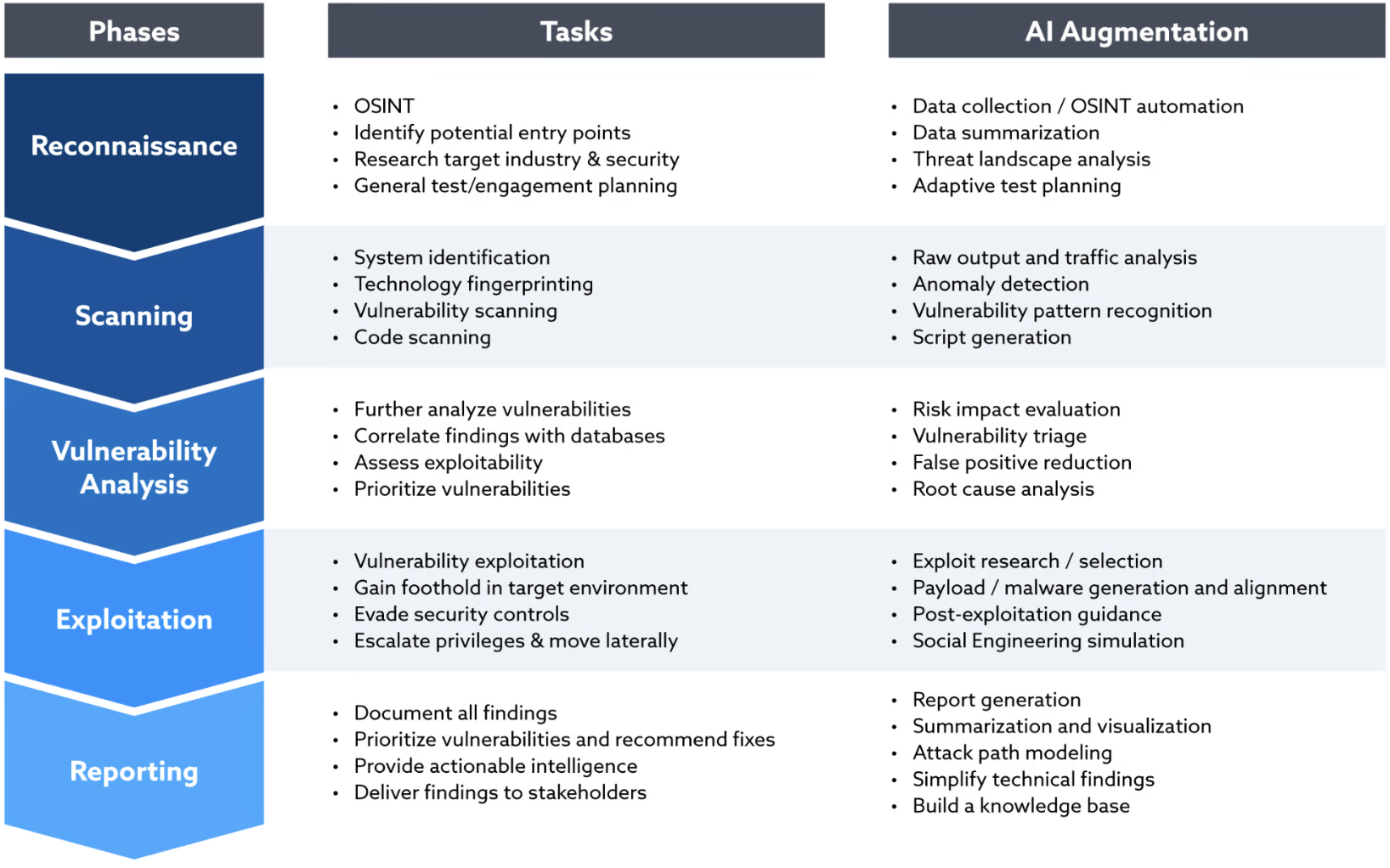

AIを利用した攻撃的セキュリティでは、人間の監視が不可欠です。 LLMを搭載した技術は予測不可能であり、意図しない動作をする可能性があります。AIの出力を検証し、品質を向上させ、技術的優位性を確保するために、人間の専門家による監視は今後も重要です。

AIエージェントの自律性のレベル

AIとともに進化するセキュリティ対策

AIは、攻撃的セキュリティのあり方を大きく変えつつあります。企業は、AIの能力を最大限に活用することで、進化するサイバー脅威に効果的に対抗することができます。

AIを導入する際には、単にツールを導入するのではなく、組織全体でセキュリティに対する意識を高め、継続的な改善を促進していくことが重要です。AIと人間の専門知識を組み合わせることで、より安全で強固なサイバーセキュリティ体制を構築することができるでしょう。

具体的には、下記のようなステップを踏むことを推奨します。

- 現状分析: 現在の攻撃的セキュリティ体制を評価し、AI導入による効果と課題を分析します。

- ツール選定: 目的や予算に合わせて、適切なAIツールを選定します。

- 人材育成: セキュリティチームのAIに関する知識・スキルを向上させるためのトレーニングを実施します。

- GRCの整備: 安全でセキュアで倫理的なAIの使用を確保するために、ガバナンス、リスク、コンプライアンス(GRC)に関するフレームワークと制御を整備します。

- 継続的な改善: AI技術は常に進化しています。最新のAI技術を常にウォッチし、必要に応じて攻撃的セキュリティ体制を見直していくことが重要です。

Webサービスや社内のセキュリティにお困りですか? 弊社のサービス は、開発チームが抱える課題を解決し、生産性と幸福度を向上させるための様々なソリューションを提供しています。ぜひお気軽にご相談ください!

参考資料: