Slush 2024:ベネディクト・エヴァンスが語る生成AIの未来—技術的課題とビジネス戦略

公開日

著名なテクノロジーアナリストであるベネディクト・エヴァンス氏は、2024年11月に開催されたSlush 2024において、生成AIの現状と未来展望に関する示唆に富むプレゼンテーションを行いました。本記事では、エヴァンス氏の発表に基づき、生成AIの技術的課題、ビジネス戦略、そして倫理的な側面について深く掘り下げて考察します。

生成AIの急速な普及と利用実態: ChatGPTの成功と課題

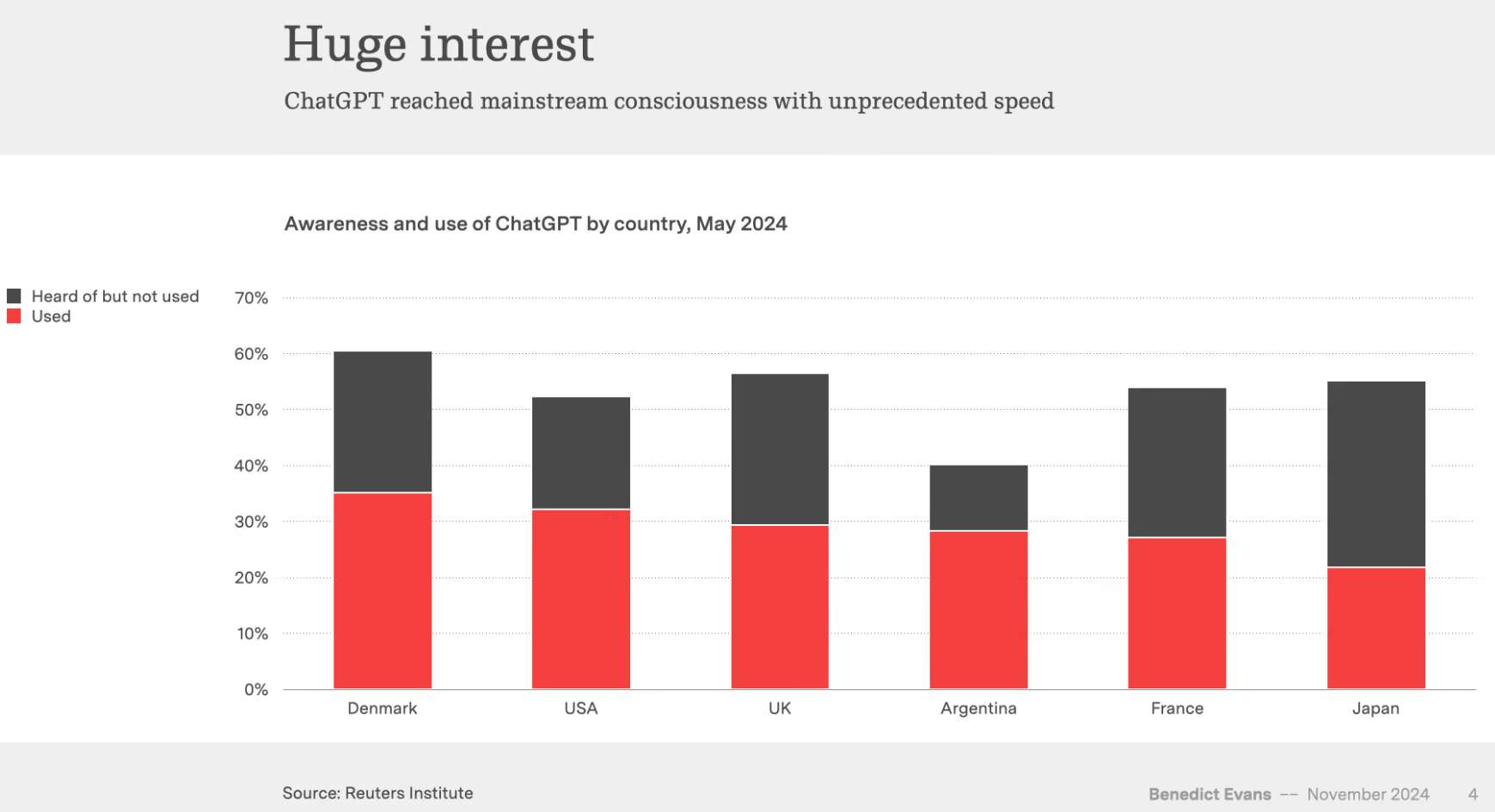

生成AI、とりわけChatGPTの登場は、AI技術の普及における新たな局面を開き、一般消費者レベルでの認知度は飛躍的に向上しました。2024年5月の時点で、調査対象となった複数の国で人口の3分の1から3分の2がChatGPTを体験、あるいはその存在を認知しています。

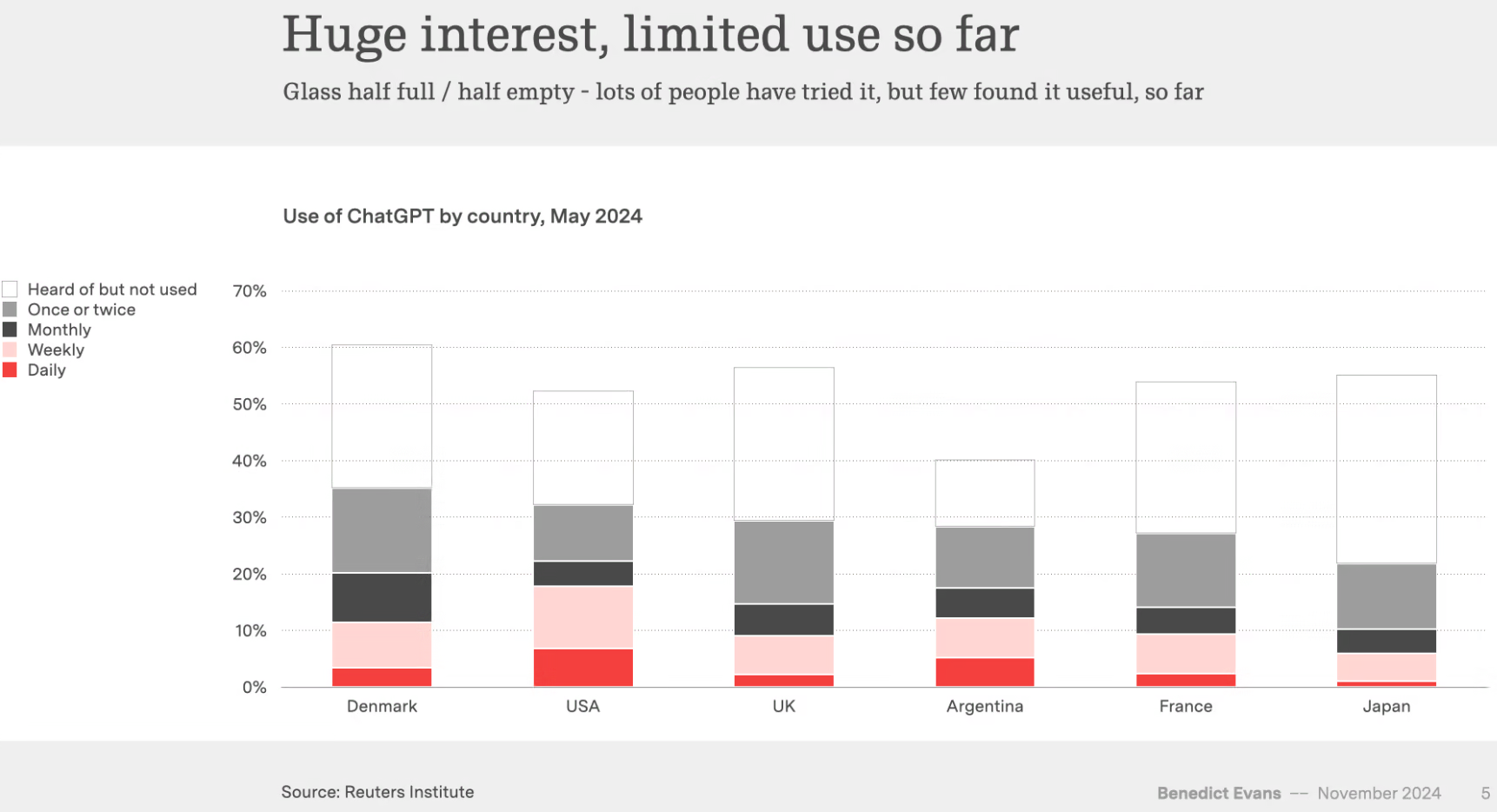

しかし、注目すべきはその利用実態です。ChatGPTを日常的に利用しているユーザーは、その認知度と比較すると、まだ少数派にとどまっているのが現実です。これは、生成AIが真の普及期を迎えるためには、日々の利用頻度を高め、企業での導入を促進する具体的な戦略が不可欠であることを示唆しています。

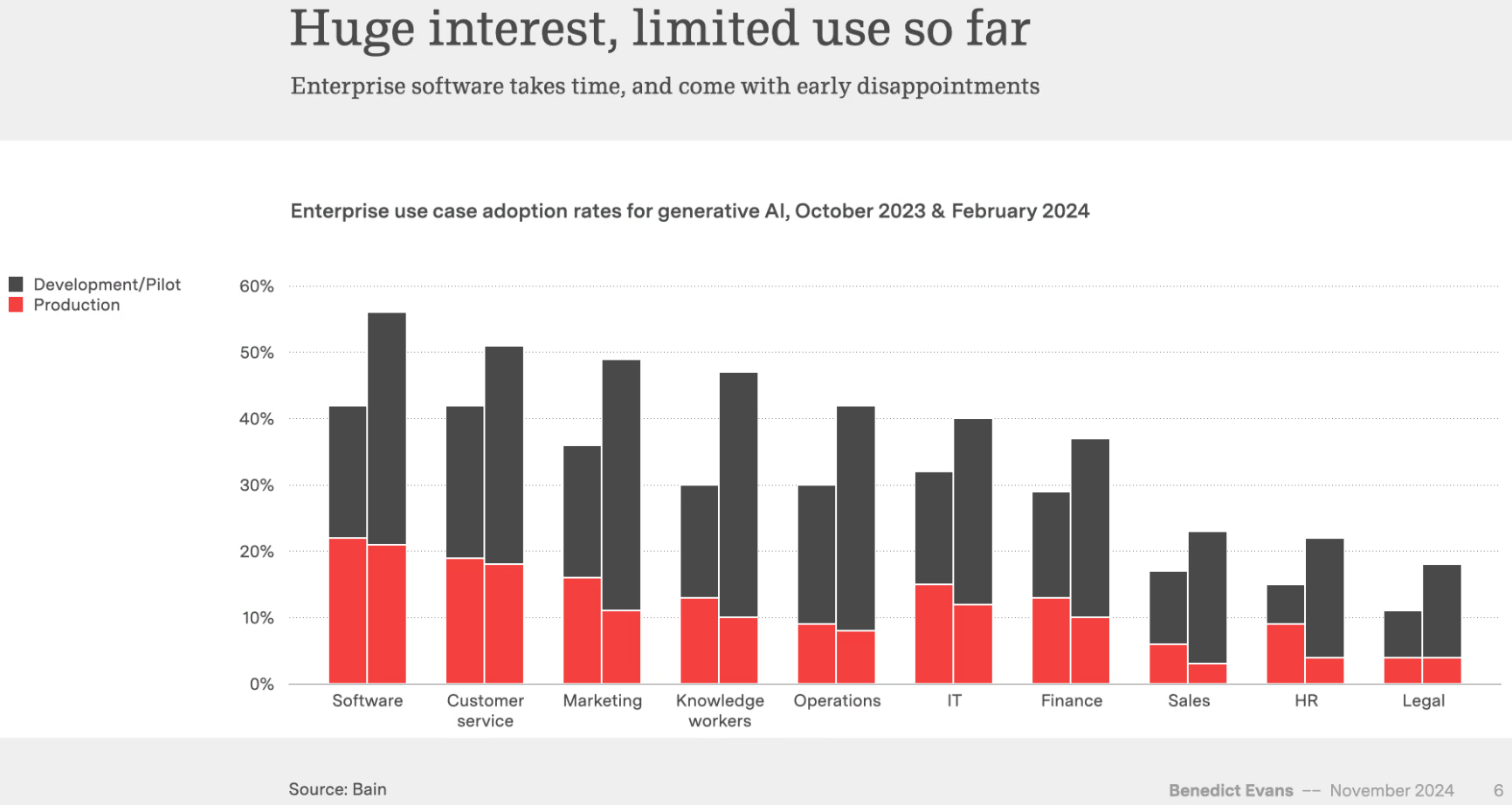

企業での導入状況も同様です。多くの企業がPoC(概念実証)やパイロットプロジェクトを実施しているものの、本格的な実運用に移行した企業はまだ少数です。

誇大広告のサイクルを超えて: 生成AIの真の価値を冷静に見極める

生成AIを取り巻く現状は、ガートナーのハイプ・サイクルの典型的なパターンを辿っています。

新技術は登場当初、過剰な期待と投資に支えられて「過剰期待のピーク期」を迎えます。しかし、その熱狂が冷め始めると「幻滅期」へと突入し、技術の限界や課題が浮き彫りになります。その後、啓蒙活動期を経て、最終的には真の価値と生産性の高まりへと繋がる「安定期」へと至ります。

現在、生成AIは「過剰期待のピーク期」にあると考えられます。巨額の投資と市場からの高い期待値が寄せられていますが、一部の専門家は、その有効性やスケーラビリティ、そして莫大な投資に見合うリターンが得られるのかどうかについて、既に疑問を呈し始めています。LLMのスケーリングの持続可能性も、重要な議論の的となっています。

生成AI: 真のプラットフォームシフトの潜在能力と課題

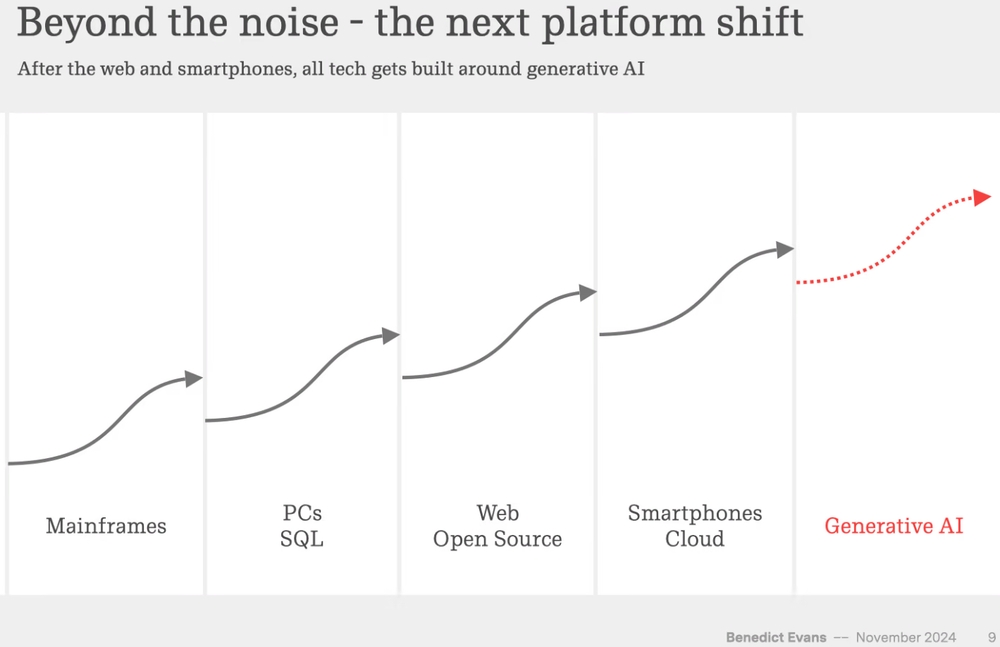

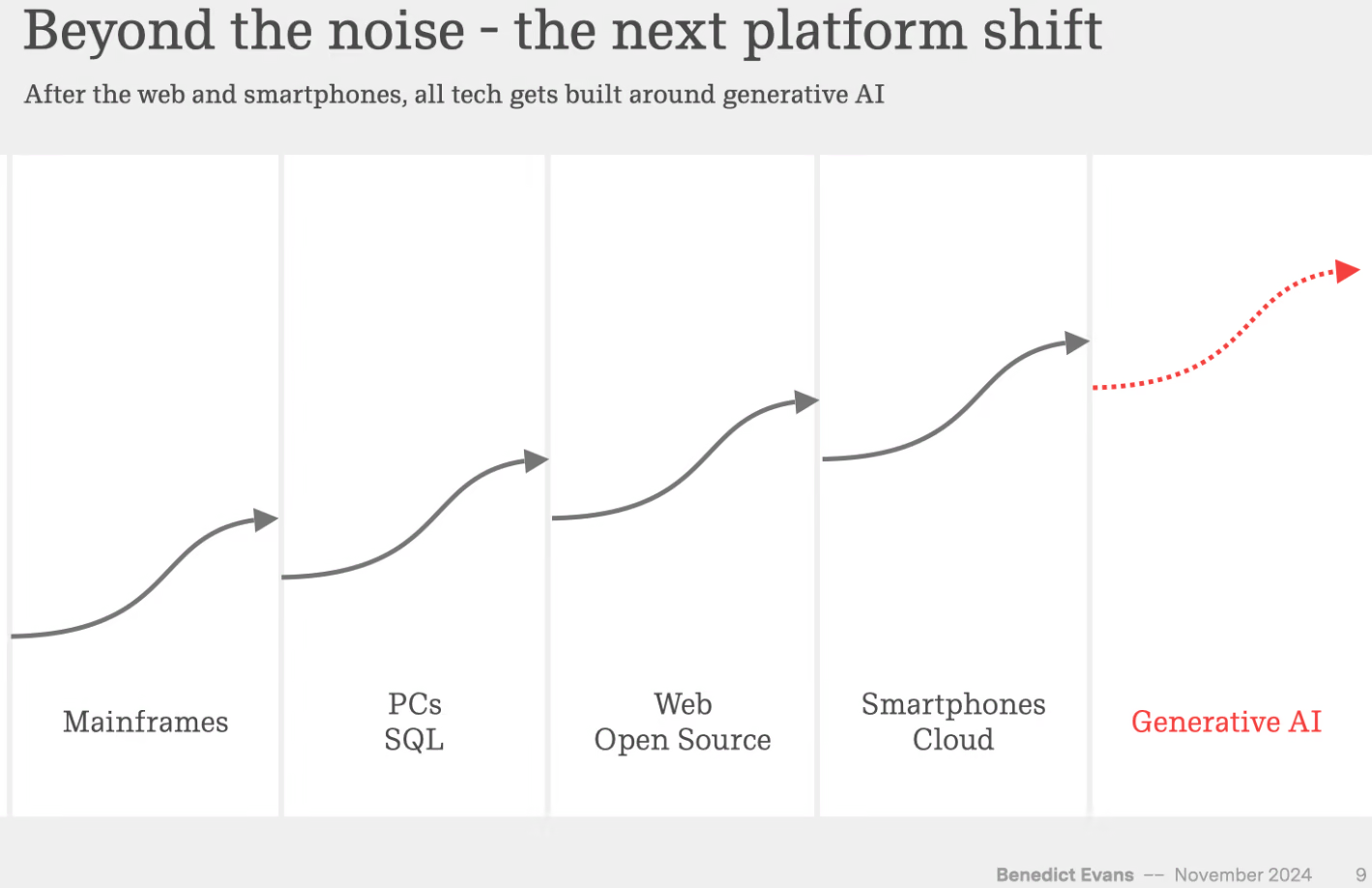

メインフレーム、PC、Web、スマートフォン、クラウド…テクノロジー業界は10〜15年ごとに大きなプラットフォームシフトを経験し、進化を遂げてきました。そして今、生成AIが次世代のプラットフォームシフトを牽引する存在として、大きな期待が寄せられています。

しかし、この革新的な技術が真のプラットフォームシフトとなるためには、スケーラビリティ、有用性、導入方法といった重要な課題を克服する必要があります。これらの課題に対する明確な答えはまだなく、今後の技術開発とビジネス戦略がその行方を左右するでしょう。

生成AIの技術的課題とビジネス戦略: LLM活用の最適解を探る

生成AI、特にLLMは、その驚異的な能力で注目を集める一方で、技術的な課題も抱えています。これらの課題を理解した上で、適切なビジネス戦略を策定することが重要です。

計算コストと効率性: LLM開発におけるジレンマ

LLMのトレーニングには、膨大な計算資源とデータ、そしてそれに伴う莫大なコストが必要です。例えば、MetaのLLMであるLlama 3.1のトレーニングには、16,000個のNvidia H100 GPUと54日間の連続稼働時間、そして約5億ドルの費用が掛かりました。 このような莫大なコストは、LLM開発の大きなボトルネックとなっています。Llama 4では10倍の計算能力が必要となる見込みであり、コストの増大は無視できない課題です。 しかし、同時に効率性向上に向けた研究開発も精力的に進められています。アルゴリズムの改良、モデルアーキテクチャの最適化、専用ハードウェアの開発といった様々なアプローチによって、コスト削減とパフォーマンス向上が期待されます。

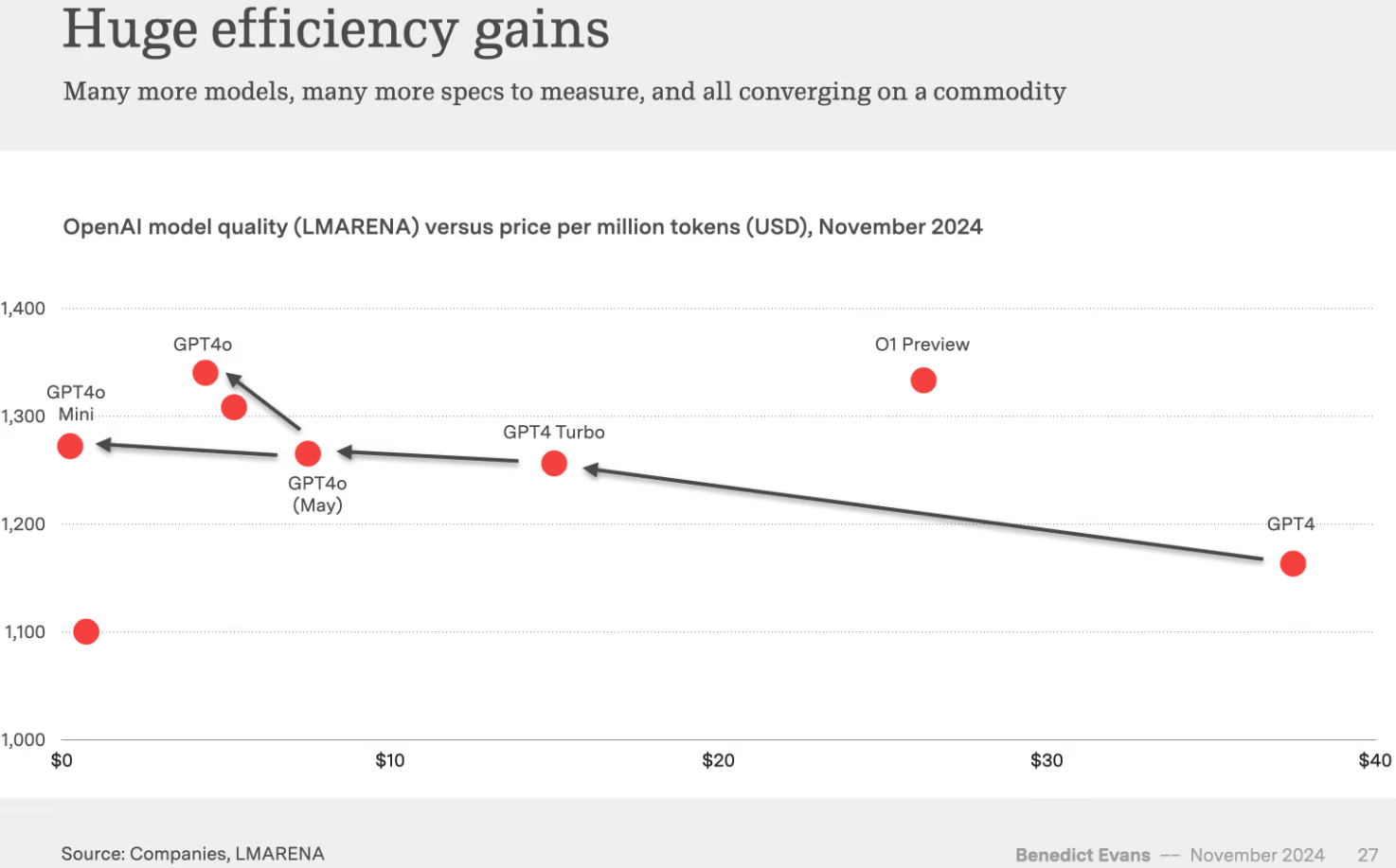

上図は、OpenAIモデルの効率化の推移を示したものです。モデルの世代が新しくなるにつれて価格が低下しており、効率性の向上が見て取れます。

LLMの活用モデル: API、インフラ、そして新たなUX

LLMをビジネスにどのように活用していくかについては、複数のモデルが考えられます。

- 既存製品への機能追加: LLMを既存製品に統合し、付加価値を提供。(例: 文章校正、要約、チャットボット)

- 新たなツールとしてのLLM: LLMを単体のツールとして提供し、特定業務を自動化・支援。(例: コード生成、文章生成、翻訳)

- LLMを中心とした新たなプラットフォーム: LLMを中核技術として、様々なアプリケーションやサービスを統合するプラットフォームを構築。LLMがUXの中核を担い、自然言語によるAIとの対話が可能になる。

これらのモデルは、それぞれ異なるビジネスチャンスと課題を内包しています。企業は、自社の戦略や強みに合致するモデルを選択し、LLMの潜在能力を最大限に活用する必要があります。

生成AIの倫理的課題: ハルシネーションとバイアス

生成AIの急速な発展は、倫理的な問題を提起しています。「ハルシネーション」や「バイアス」といったリスクへの対応は、AI開発者のみならず、利用者、そして社会全体で議論を深め、対策を講じていく必要があります。

ハルシネーション: AIが生成する「嘘」

生成AIは学習データに基づいてテキストを生成するため、事実とは異なる情報、いわゆる「ハルシネーション」を生成する可能性があります。顧客対応などでハルシネーションが発生すると、誤った情報が提供され、企業の信頼失墜につながるリスクがあります。

ハルシネーションを防ぐためには、AIモデルの学習データの質を高めるだけでなく、出力結果を人間がチェックする仕組みや、ユーザーフィードバックを活用する仕組みの導入が重要です。

バイアス: 公平性と倫理性の担保

AIモデルは学習データに含まれるバイアスを反映する傾向があります。人種、性別、宗教などに関するバイアスが含まれたデータで学習されたAIは、差別的なアウトプットを生成する可能性があり、社会的な問題につながる危険性があります。バイアスを軽減するには、学習データの多様性を確保し、バイアスを検出・修正する技術を開発するなど、AIの公平性と倫理性に関する継続的な取り組みが必要です。

結論: 生成AIは真の革新となるか?

生成AIは、私たちの社会やビジネスを大きく変える可能性を秘めた革新的な技術です。しかし、同時に、ハルシネーションやバイアスといった課題、そして倫理的な問題についても、開発者、利用者、そして社会全体で議論を深め、適切な対策を講じていく必要があります。生成AIは単なる一過性のブームで終わるのか、それとも真の革新をもたらすのか、今後の動向に注目が集まります。

開発生産性やAI対応にお困りですか? 弊社のサービス は、開発チームが抱える課題を解決し、生産性と幸福度を向上させるための様々なソリューションを提供しています。ぜひお気軽にご相談ください!

参考資料: