オープンソース開発で生成AIをどう管理する?OSSコミュニティのガバナンス最新動向

公開日

プログラミングにおける生成AIの活用は日常的なものとなり、オープンソースソフトウェア(OSS)の開発にも大きな変革をもたらしています。しかし、コードやドキュメントの自動生成が容易になった一方で、コミュニティの品質維持やプロジェクト管理者の負担増加といった新たな課題も浮き彫りになっています。

本記事では、北京大学の研究チームが発表した論文「Beyond Banning AI: A First Look at GenAI Governance in Open Source Software Communities」に基づき、OSSコミュニティにおける生成AIのガバナンスの現状を解説します。実際のプロジェクトでどのような問題が発生し、どのようなルールが設けられているのかを詳しく紐解いていきます。

オープンソース開発における生成AIの現状と調査概要

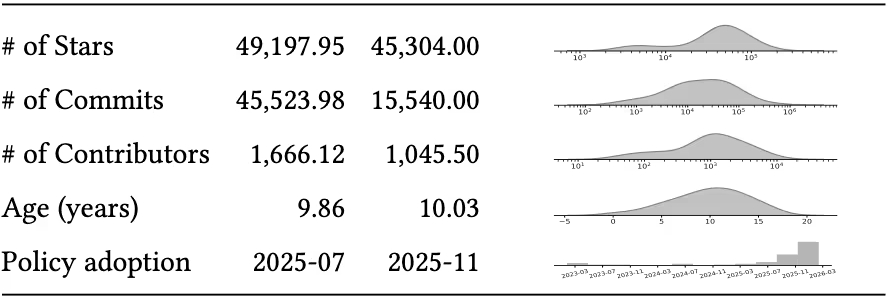

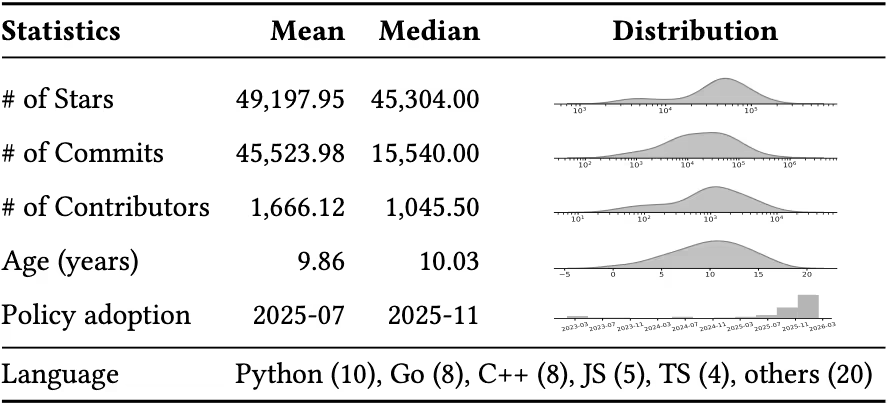

本調査は、2026年2月時点の、影響力の大きい67のOSSプロジェクト(主にGitHub上のプロジェクト)のガイドラインやポリシー文書を対象に、生成AIに関連するガバナンスの実態を分析したものです。

図表1:サンプリングされたGitHubプロジェクトの属性データ

生成AIの登場により、開発者がコミュニティに参加するハードルは大きく下がりました。AIエージェントがリポジトリを自律的にナビゲートし、完全なパッチを生成するケースも増えています。しかし、生成コストが下がったからといって、人間がそれをレビューするコストまで下がるわけではありません。

プルリクエスト(PR)の数が爆発的に増加した結果、多くの有名OSSプロジェクトがメンテナンスの限界を超え、混乱に直面しています。 あるプロジェクト では、AIによって生成された19,000行にも及ぶPRが提出され、開発者からの猛反発を招く事態も起きました。このような状況下で、各プロジェクトは生成AIとどのように付き合っていくべきか、ルール作りに迫られています。

OSSメンテナを悩ませる7つの具体的な懸念事項

現場のメンテナ(管理者)たちは、生成AIの台頭に対してどのような不安を抱いているのでしょうか。調査の結果、AIの活用は単なるコード生成にとどまらず、イシューの登録からセキュリティ報告に至るまで、幅広いプロセスにおいて7つの明確な懸念を引き起こしていることが分かりました。

- コード貢献におけるレビューのボトルネック: AIはもっともらしいコードを生成しますが、表面的な正確さが意味的な正確さを保証するわけではありません。誰が責任を持って変更内容を説明するのかが曖昧になり、メンテナの確認作業が膨大になります。

- コミュニケーションの質の低下: PRの説明文などに、コードの差分をそのまま書き起こしただけのAIテキストが使用され、人間同士の有意義な議論が失われることが懸念されています。

- トリアージ(優先度付け)のコスト増: イシュー報告が長文化・もっともらしくなる一方で、問題解決に必要な核心的な情報が欠けており、仕分け作業の手間が増加しています。

- セキュリティ報告チャネルの圧迫: 偽造された、あるいは検証不可能なAIによる脆弱性報告が増え、優先して処理すべき本当のセキュリティ課題への対応が遅れるリスクがあります。

- 悪意のあるインセンティブ: バグ発見の報酬制度(バグバウンティ)などが存在する場合、AIを利用して無価値な報告を大量に行う動機付けになってしまいます。

- 著作権とライセンスの不確実性: AIが出力したコードの著作権や、OSSライセンスとの適合性が法的に不明確であるという懸念です。

- プラットフォームとツールの限界: GitHubなどのプラットフォームが提供するAI機能のデフォルト設定が、これらの問題をさらに助長しているという指摘です。

これらの懸念は、生成AIの出力品質に対する不安だけでなく、限られた人間のリソースがどう奪われるかという「システム全体の維持」に関わる深刻な問題です。

生成AIの受け入れを左右する「3つの基本方針」

同じように生成AIの波に直面していても、プロジェクトごとに対応の仕方は大きく異なります。研究チームは、プロジェクトが採用しているガバナンスの方向性を、大きく3つの基本方針に分類しました。

- 方針1:完全禁止 / ゼロトレランス AI生成コンテンツのライセンス問題や出所の不確実性を構造的なリスクと捉え、ワークフローへの受け入れを一切拒否する方針です。「AI由来の貢献は認めない」と明確に規定し、レビュー段階に至る前に入口で遮断します。

- 方針2:境界の設定と説明責任 透明性や説明責任、検証可能性などの明確な条件を満たした場合に限り、AIの使用を許可する方針です。AIツールをあくまで「補助」として位置づけ、使用の開示や人間の責任を厳格に求めます。

- 方針3:品質第一 / ツールに依存しない AIが使用されたかどうかを問題にするのではなく、コードの保守性やレビューへの負荷など、従来の品質基準を満たしているかどうかで評価する方針です。専用のAIルールを作るのではなく、既存の品質管理プロセスで対応しようとします。

これらの方針は、プロジェクトの成熟度やドメインの特性によって決定され、それぞれのコミュニティに合った独自のルール形成へと繋がっていきます。

コミュニティを守るための「12のガバナンス戦略」

前述の基本方針を具体的なルールとして機能させるため、各プロジェクトは様々な戦略を組み合わせています。ここでは、調査から抽出された12の具体的なガバナンス戦略を、4つの機能グループに分けて紹介します。

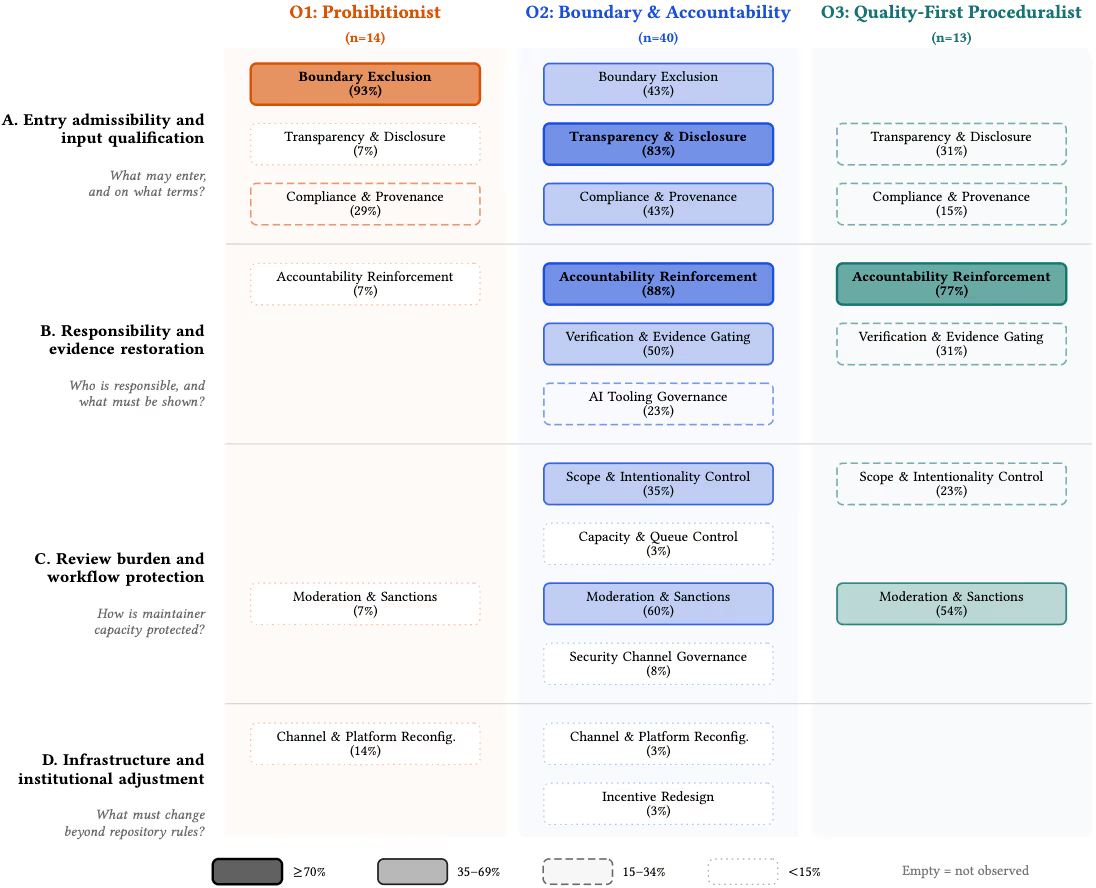

図表2:機能グループ(行)およびガバナンス方針(列)別にマッピングされたガバナンス戦略

図表2が示す通り、採用する方針によって重視される戦略の偏りが確認できます。それぞれの機能グループは以下の役割を果たしています。

A. エントリーの許容性と入力の要件 システムにどのような入力を許可するかを決定します。特定のAI入力を排除する「境界排除」、AI使用の報告を義務付ける「透明性と開示」、そして提出前にライセンス確認を求める「コンプライアンスと出所の保護」が含まれます。

B. 責任と証拠の提示要件 薄れがちな責任を人間側に取り戻すための戦略です。ツールではなく人間のコントリビューターが責任を負うことを明記する「説明責任の強化」、テストログなどの提出を求める「検証と証拠の要求」、そしてツール自体の動作を制御する「AIツールのガバナンス」が含まれます。

C. レビュー負担とワークフローの保護 すでに提出されたデータからメンテナの時間を守るための戦略です。事前のイシュー作成を求める「スコープと意図の制御」、同時に出せるPR数を制限する「キャパシティとキューの制御」、違反者をブロックする「モデレーションと制裁」、証拠基準を厳格化する「セキュリティチャネルのガバナンス」が含まれます。

D. インフラと制度の調整 リポジトリ単位のルールでは対応しきれない場合にとられる強力な措置です。外部からのPR受付を停止したりプラットフォームを移行したりする「チャネルとプラットフォームの再構成」や、悪用を防ぐために報酬制度自体を取りやめる「インセンティブの再設計」が含まれます。

【最新動向】Linuxカーネルにおける導入事例

これらの方針や戦略が実際にどのように機能しているかを示す好例として、先日、世界最大のOSSプロジェクトの一つであるLinuxカーネルの公式ドキュメントに追加された「AI Coding Assistants」のガイドラインがあります。

このガイドラインは、本論文で指摘されている戦略を如実に体現しています。

- コンプライアンスの保護: すべての貢献は「GPL-2.0-only」と互換性がなければならないと明記されています。

- 説明責任の強化: AIエージェントが自ら「Signed-off-by(署名)」タグを追加することは固く禁じられています。人間の提出者がコードをレビューし、法的な証明を行い、貢献に対する「完全な責任(Taking full responsibility)」を負うことが義務付けられました。

- 透明性と開示: AIツールを使用して貢献する場合は、AIの役割の変遷を追跡するため、

Assisted-by: Claude:claude-3-opusのようにAIツール名とモデルバージョンを開示するタグの付与が求められています。

このように、影響力の大きなLinuxコミュニティも明確に「方針2:境界の設定と説明責任」を採用し、人間の責任を厳格に維持しながらAIの恩恵を受け入れる枠組みを構築していることが分かります。

まとめ:ツールルールの枠を超えたプラットフォームの変革へ

生成AIがOSSコミュニティにもたらした課題は、「AIを許可するか禁止するか」という単純な二項対立で解決できるものではありません。調査対象となったプロジェクトは、許容範囲の決定から説明責任の強化、検証プロセスの見直しに至るまで、多角的なガバナンスを構築して対抗しています。

しかし、テキストベースのガイドラインを整備するだけでは、自律型のAIエージェントや労力をかけない人間の投稿を完全に防ぐことは困難です。今後はプロジェクト単位のルール策定を超えて、プラットフォーム側がAIのメタデータを機械可読な形で提供するなど、インフラレベルでの対応が不可欠となるでしょう。

オープンソースの発展には、人間の協力とテクノロジーの融合が欠かせません。生成AIの生産性向上の恩恵を受けつつ、コミュニティの疲弊を防ぐための新たな基盤づくりが、今まさに求められています。

生成AIの導入や活用にお困りですか? 弊社のサービス は、開発チームが抱える課題を解決し、生産性と幸福度を向上させるための様々なソリューションを提供しています。ぜひお気軽にご相談ください!

参考資料: